Deepfake : सध्या रश्मिका मंदानाचा एक मॉर्फ व्हिडीओ समाज माध्यमांवर व्हायरल होत आहे. याव्हिडीओत एक महिला लिफ्टमध्ये जाताना दिसत असून ती रश्मिका मंदाना असल्याचा दावा केला जातोय. प्रथमदर्शनी या व्हिडीओतील महिला रश्मिका मंदाना असल्याचा भास होतो. मात्र ‘डीपफेक तंत्रज्ञान’च्या मदतीने हा व्हिडीओ तयार करण्यात आला आहे. याच पार्श्वभूमीवर Deepfake तंत्रज्ञान काय आहे? त्याचा वापर कोठे केला जातो? रश्मिका मंदानाच्या नावाने व्हायरल होत असलेल्या व्हिडीओचे सत्य काय आहे? हे जाणून घेऊ या…

Instagram | इंस्टाग्रामवर तुमचा व्यवसाय घेऊन या; काही मिनिटांतच सुरु होईल चांगली कमाई

Table of Contents

रश्मिकाच्या नावाने व्हायरल झालेल्या व्हिडीओचे सत्य काय ?

रश्मिका मंदानाच्या नावाने सध्या एक व्हिडीओ व्हायरल होत आहे. या व्हिडीओतील महिला रश्मिका मंदाना असल्याचा दावा केला जात असून तो काही क्षणांत समाजमाध्यमांवर व्हायरल झाला आहे. त्यानंतर बॉलिवडूमधील अनेक अभिनेत्यांनी त्यावर प्रतिक्रिया दिल्या आहेत. दरम्यान, व्हायरल होत असलेल्या व्हिडीओतील महिला रश्मिका मंदाना नाही. व्हिडीओतील खऱ्या महिलेचे नाव झारा पटेल असून ती भारतीय वंशाची ब्रिटिश नागरिक आहे. डीपफेक तंत्रज्ञानाचा वापर करून झारा पटेल यांच्या चेहऱ्यावर रश्मिका मंदानाचा चेहरा लावण्यात आला आहे. याच कारणामुळे सामान्य लोकांना व्हायरल व्हिडीओतील महिला ही रश्मिका मंदाना असल्याचा भास होतोय.

Deepfake म्हणजे काय?

आधूनिक तंत्रज्ञानाच्या मदतीने तयार केलेले हे एक एआय टूल आहे. या तंत्रज्ञानाला २१ व्या शतकातील फोटोशॉपिंग म्हणता येऊ शकते. डीपफेकमध्ये एआयचाच एक भाग असणाऱ्या ‘डीप लर्निंग’च्या मदतीने प्रत्यक्षात न घडलेल्या घटनेच्या प्रतिमांची निर्मिती करता येऊ शकते. Deepfake या तंत्रज्ञानात व्हिडीओ किंवा फोटोमध्ये असलेल्या व्यक्तीची दुसऱ्या एखाद्या व्यक्तीशी अदलाबदल करता येऊ शकते. अगदीच सोप्या भाषेत एखादे उदाहरण द्यायचे झाले तर, एखाद्या प्रतिमेत किंवा व्हिडीओमध्ये प्रत्यक्ष तुम्ही हजर नसलात तरी दुसऱ्या एखाद्या व्यक्तीच्या चेहऱ्यावर तुमचा फोटो (प्रतिमा) या तंत्रज्ञानाच्या सहाय्याने चपखलपणे लावता येतो. म्हणूनच या तंत्रज्ञानाचा वापर मोठ्या प्रमाणात अश्लील डीपफेक व्हिडीओ तयार करण्यासाठी केला जात आहे. एखाद्या व्यक्तीचा चेहरा वापरून अश्लील दृक्-श्राव्य चित्रण, या माध्यमात केले जाते.

I feel really hurt to share this and have to talk about the deepfake video of me being spread online.

— Rashmika Mandanna (@iamRashmika) November 6, 2023

Something like this is honestly, extremely scary not only for me, but also for each one of us who today is vulnerable to so much harm because of how technology is being misused.…

Deepfake तंत्रज्ञान काय आहे ?

‘डीपफेक’ हा शब्द कृत्रिम बुद्धिमत्तेच्या (AI) प्रकारातून आला आहे. ज्याला डीप लर्निंग म्हणतात. नावाप्रमाणेच deepfakes बनावट घटनांच्या प्रतिमा तयार करण्यासाठी सखोल शिक्षण वापरतात. डीप लर्निंग अल्गोरिदम डेटाच्या मोठ्या संचातील समस्यांचे निराकरण कसे करावे हे स्वतःला शिकवू शकतात. हे तंत्रज्ञान बनावट मीडिया तयार करण्यासाठी व्हिडिओ आणि इतर डिजिटल सामग्रीमध्ये चेहरे बदलण्यासाठी वापरले जाते. शिवाय, डीपफेक केवळ व्हिडिओंपुरते मर्यादित नाही, या तंत्रज्ञानाचा वापर प्रतिमा, ऑडिओ इत्यादी इतर बनावट सामग्री तयार करण्यासाठी देखील केला जाऊ शकतो.

Deepfake तंत्रज्ञानाचे धोके :

डीप फेक टेक्नॉलॉजीच्या मदतीने कुणाची बदनामी होऊ शकते. डीप फेकचा वापर विशेषतः महिला आणि मुलींना लक्ष्य करतो. कोणत्याही व्यक्तीचे त्याच्या सोशल मीडिया प्रोफाइलवरून खाजगी फोटो काढून बनावट अश्लील व्हिडिओ बनवता येतात. कोणत्याही नेत्याचा एमएमएस करता येतो. या तंत्रज्ञानाच्या मदतीने त्यांनी कधीही न दिलेल्या भाषणांचे व्हिडिओ प्रसिद्ध करता येणार आहेत.

Deepfake तंत्रज्ञानापासून कसं वाचायचं?

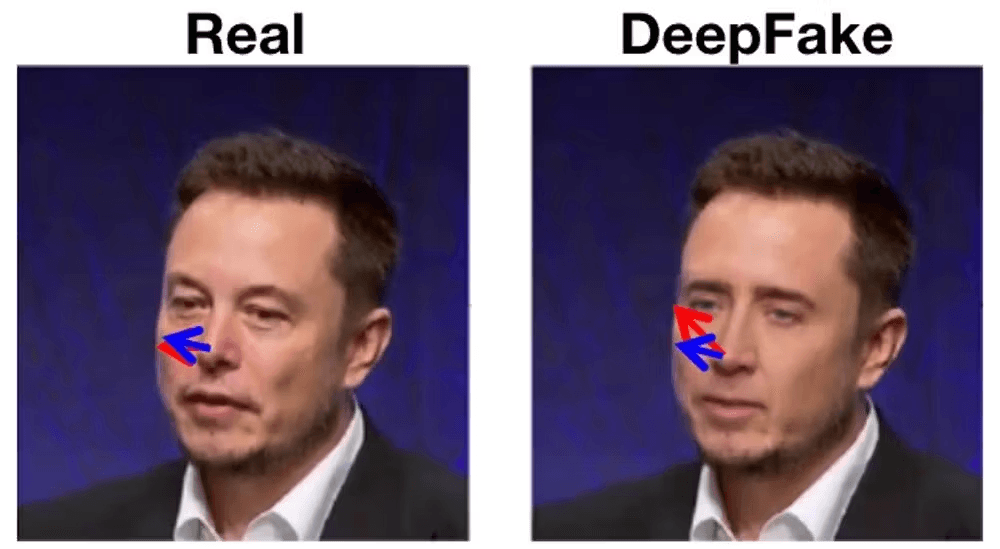

डीपफेक या टेक्नॉलॉजी पासून वाचण्यासाठी कोणत्याही सोशल मीडिया प्लॅटफॉर्मवर आपला फोटो शेअर करताना काळजी घ्या. असा प्रकार तुमच्या सोबत घडल्यास तात्काळ पोलिसांमध्ये तक्रार दाखल करा. तर हा डीपफेक काँटेंट ओळखण्यासाठी तुम्ही संबंधित व्हिडिओमधील व्यक्तीचे स्किनचा कलर, अंगाची ठेवण यातील फरक, डोळ्यांजवळची वर्तुळ, डोळ्यांची होणारी उघडझाप किंवा नजर, तोंड आणि चेहऱ्याचे हावभाव, चेहरा आणि ओठांचा ताळमेळ नसणे, चेहरा आणि केसांचा ताळमेळ नसणे, चेहऱ्यावरील खुणा मॅच न होणे. या सर्व गोष्टींच्या तपासणी आणि तुम्ही हा व्हिडिओ फेक आहे किंवा नाही हे जाणून घेऊ शकता.

Deepfake तंत्रज्ञानावर कायदा काय सांगतो ?

डीप फेक तंत्रज्ञानावर काही प्रमुख प्लॅटफॉर्मवर बंदी घालण्यात आली आहे. कारण या तंत्रज्ञनाचा गैरवापर केला जाऊ शकतो. कधीकधी चुकीची माहिती पुरवण्यासाठी किंवा एखाद्याची बदनामी करण्याची या तंत्रज्ञानाचा वापर केला जाऊ शकतो. अशा तंत्रज्ञानाचा वापर चुकीच्या हेतूने करण्यात आल्याच्या अनेक घटना भारतात घडल्या आहेत. मात्र, भारतात अशा घटनांना तोंड देण्यासाठी कोणतीही कठोर, कायदेशीर आणि नियामक चौकट नाही.